商品详情

书名: 大模型时代

定价: 88.00

ISBN: 9787500173953

作者: 龙志勇,黄雯

出版社: 中译出版社

出版日期: 2023-05

装帧: 平装

开本: 32

1、一本书讲透ChatGPT的前世、今生与未来,实现从AI小白到高手的进化。

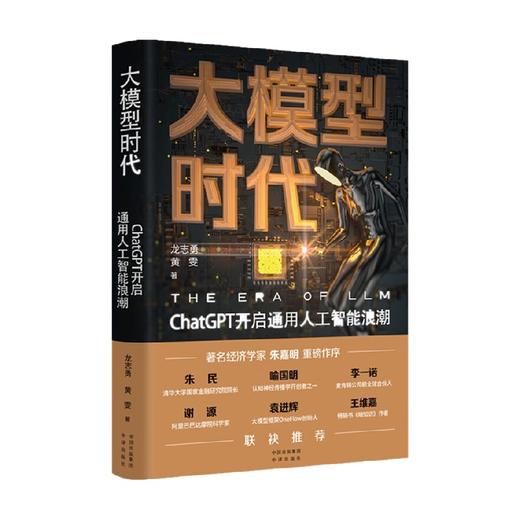

2、重磅专家荐:著名经济学家朱嘉明作序,育长江学者特聘教授喻国明,畅销书《暗知识》作者、师从人工智能鼻祖伯纳德·威德罗的王维嘉博士,等倾情荐。

3、聚焦前沿热点:揭秘以ChatGPT为代表的大语言模型爆火背后有哪些原因?有何时代价值与意义?

描绘应用蓝图:大语言模型给哪些产业带来了福音?相关技术究竟能派上什么用场?

远瞻行业风险:机遇来临之际还将迎来哪些挑战?我们该如何应对?

ChatGPT火爆全球,但大语言模型(Large Language Model)才是幕后真正的智能“大脑”!生成式大模型正在开创新的时代,基于生成式预训练大模型的技术突破,也在带来面向个人、深入行业的多重应用。这势引发新一轮的智力革命和产业重构,构建全新的脑机协作关系。但在同时,与机会如影随形的泡沫也会随之涌现。

为此,本书对大模型时代的技术、应用和产业变化进行了深入的分析和阐述。本书首先将专业的技术知识通过拟人化的形式进行呈现,生动形象地解释了ChatGPT大模型背后的原理,对这一赋能大模型变革技术与产业的基础能力进行深度剖析;其次,本书以三次工业革命的历史和逻辑作为参照,描绘出大模型将如何驱动社会进入智能革命和脑机协作时代,并为个人和企业应对此次变革提出建议;第三,本书对大模型在知识工作、商业企业、创意娱乐等领域的具体应用进行介绍,总结了企业在自身业务中应用大模型的注意事项和方法论;后,本书对国内外大模型产业的构成和发展进行了分析,并对暗藏泡沫隐患的风险点位做出预警。

荐序/朱嘉明

前言

一篇:技术篇

01| 我是一个传话筒

02| 我是一个大模型

03| ChatGPT 是怎样炼成的

预训练:大模型的内力之源

生成式:孤勇者的家传绝学

Chat:见招拆招,智慧之光闪耀

04| 大模型的未解之谜

涌现:复杂系统的进化与失控

幻觉:我是一个演员

多模态和插件:读懂并驱动世界

第二篇:变革篇

05| 大机器时代的启示

痛苦的恩格斯式停顿

新技术的使能效应

从家庭到工厂,从蒸汽到电动

技术与教育之间的竞赛

06| 大模型与智力革命

大模型的知识处理能力提升

重新定义人类知识

07| 自然语言编程与脑机协作

从“搜商”到“问商”

3R 任务授权法

苏格拉底提问法

副驾,还是代驾?

08| 变革时代的韵脚

第三篇:应用篇

09| 大模型应用的两种创新

10| 知识工作型应用

教育应用

人力资源应用

法律工作应用

政府工作应用

数字游民:个人IP工作应用

知识工作型应用总结

11| 企业业务型应用

市场营销

售前沟通

售后服务

产品设计

商业分析

会议助理

企业业务型应用总结

12| 创意娱乐型应用

创作助手

数字人角色扮演

旅行计划助手

创意娱乐型应用总结

13| 大模型应用的三重境界

第四篇:产业篇

14| 大模型产业拆解

硬件基础设施

针对大模型优化的 GPU 和云服务

软件基础设施

适合大模型的分布式深度学习框架

大模型的数据工具

模型库社区

模型即服务层

闭源大模型

开源大模型

模型企业服务

应用层

ChatGPT

Cocounsel

Character.ai

15| 关于大模型产业的对话—1集

北京,咖啡馆的小聚

小结

16| 寒来暑往几度:AI泡沫与机遇

美的资本叙事

别想比安全员先下车

谁是好的AI商业公司

17| 关于大模型产业的对话—第2集

山景城,计算机历史博物馆的重逢

深蓝

无人车

ELIZA

第五代

小结

后记

龙志勇,☆龙志勇,曾任阿里巴巴资深产品专家兼事业部副总经理、硅谷AI创业公司联合创始人兼首席运营官,获GMIC“AI Startup Top10”等荣誉,在人工智能、云计算、互联网行业深耕20余年。曾撰文《从<华为的冬天>到AI的冬天》,并有多本畅销译著:《如何创造可信的AI》《稀缺》《超级合作者》《需求》等。

黄雯,☆黄雯,互联网大厂高级AI产品经理,曾就职于腾讯和AI创业公司,积累了丰富的AI产业互联网、自然语言处理和大模型应用经验。

书摘1——来自技术篇

老莫:“模型参数多,代表模型学到的东西多;模型复杂度高,在回答你小纸条问题的时候,我预测每一个字的准确率就高。我学到的关于世界的许多知识,也都保存在这些模型参数中。而 且,当我学的内容丰富到一定程度之后,还会涌现出意外之喜,突然就学会了许多以前没见过、连想都不敢想的本事。参数规模就像是浑厚的内力,是大模型成功的基础。”

小二:“这个我懂!武侠小说里讲过,内力修炼到高深之处,天下武功皆可为我所用,飞花摘叶皆可伤敌于无形,对吧?不过我还没明白,你的大,跟预训练又有什么关系呀?”

老莫:“你还是没明白。我这个大模型是怎么大起来的,这么多参数是怎么来的,靠的是对语言大数据的预训练啊。人类为了训练我,搜集整理了超级海量的语言数据让我学习,我们上一代的GPT-3读过的文本就有上百GB呢,几千亿的字数,相当于19万套四大名著的阅读量。

…………

…………

小二(着急了):“别忘了还有我呢!老莫,我来给你总结一下。你读过海量的书和网页,做过海量的文字接龙习题,这叫生成式预训练,这阶段你积累了大量的知识和技能,相当于有了排山倒海的浑厚内力,但还不会用、用不好;然后呢,你跟师父学了薄薄的一本《问答宝典》,这叫监督学习,这阶段你开始逐渐解锁一些技能,知道人类会出哪些招,自己要应什么招;再后来,师父训了一个奖励模型来陪你,又做了大量的人类反馈强化学习,这以后,你的回答就越来越像人话了!

小二(着急了):“别忘了还有我呢!老莫,我来给你总结一下。你读过海量的书和网页,做过海量的文字接龙习题,这叫生成式预训练,这阶段你积累了大量的知识和技能,相当于有了排山倒海的浑厚内力,但还不会用、用不好;然后呢,你跟师父学了薄薄的一本《问答宝典》,这叫监督学习,这阶段你开始逐渐解锁一些技能,知道人类会出哪些招,自己要应什么招;再后来,师父训练了一个奖励模型来陪你,又做了大量的人类反馈强化学习,这之后,你的回答就越来越像人话了!”

- 中信书店 (微信公众号认证)

- 美好的思想和生活

- 扫描二维码,访问我们的微信店铺

- 随时随地的购物、客服咨询、查询订单和物流...