商品详情

书名:TensorFlow深度学习:数学原理与Python实战进阶

定价:99.0

ISBN:9787111645849

作者:[印]桑塔努•帕塔纳雅克(Santanu Pattanayak)

编辑推荐

掌握深度学习数学原理、编程实战经验

轻松构建复杂实际项目的深度学习方案

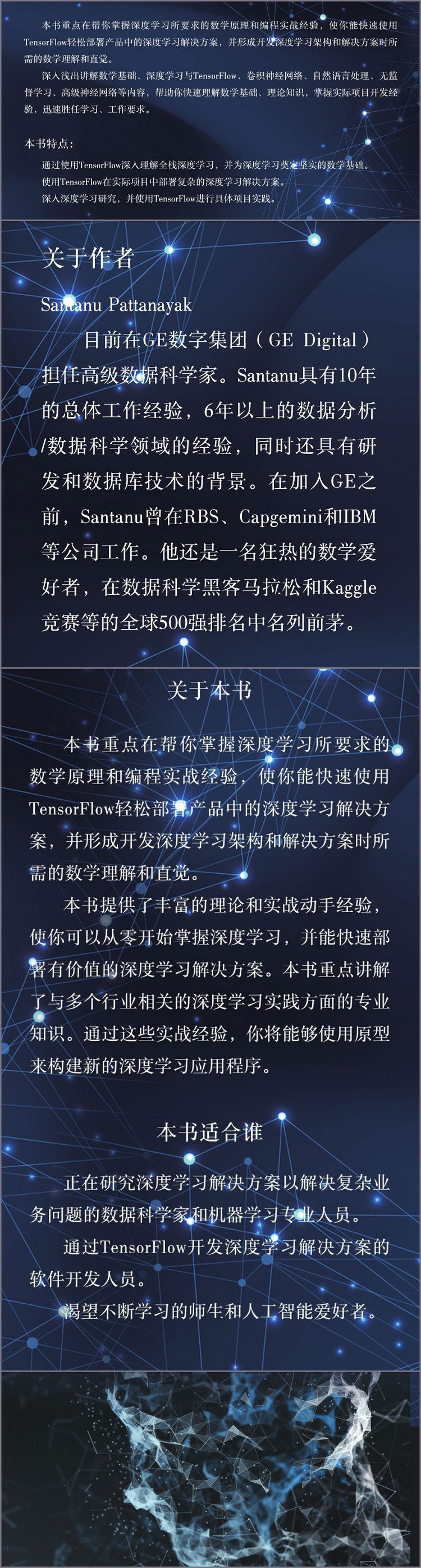

关于作者

Santanu Pattanayak,目前在GE数字集团(GE Digital)担任高级数据科学家。Santanu具有10年的总体工作经验,6年以上的数据分析/数据科学领域的经验,同时还具有研发和数据库技术的背景。在加入GE之前,Santanu曾在RBS、Capgemini和IBM等公司工作。他还是一名狂热的数学爱好者,在数据科学黑客马拉松和Kaggle竞赛等的全球500强排名中名列前茅。

原书前言

本书是使用TensorFlow实现深度学习的数学原理和编程实战指南。深度学习是机器学习的一个分支,你可以在其中根据概念的层次结构为世界建模。这种学习模式类似于人脑的学习方式,它允许计算机对复杂的概念进行建模,而这些概念在其他传统的建模方法中通常没有被注意到。因此,在现代计算范式中,深度学习在对复杂的实际问题进行建模时扮演着至关重要的角色,尤其是通过利用如今大量可用的非结构化数据。

由于深度学习模型涉及内容的复杂性,很多时候使用它的人们都将其视为黑盒子。但是,为了从机器学习这一分支中获得最大的收益,需要通过研究与之相关的科学和数学来发现隐藏的奥秘。在本书中,我们从数学和科学的角度都非常谨慎地解释了与深度学习相关的概念和技术。此外,第1章专注于构建轻松理解深度学习概念所需的数学基础。TensorFlow被选为深度学习软件包,是因为它在用于研究目的上的灵活性以及易用性。选择TensorFlow的另一个原因是它能够使用其服务功能轻松地在实时生产环境中加载模型。

总而言之,本书提供了大量实用的实战知识,因此你可以从零开始学习深度学习并部署有价值的深度学习解决方案。本书将能帮助你迅速上手使用TensorFlow,并优化了实际应用中不同的深度学习架构。本书重点关注与多个行业相关的深度学习的实践方面的内容。你将能够使用演示的原型来构建新的深度学习应用程序。本书中的代码以iPython笔记本和脚本的形式提供,让你可以尝试示例并以有趣的方式扩展它们。阅读学习本书后,你将具备数学基础和专业知识,可以从事该领域的研究并回馈社区。

读者对象

● 本书面向正在研究深度学习解决方案以解决复杂业务问题的数据科学家和机器学习专业人员。

● 本书适用于通过TensorFlow开发深度学习解决方案的软件开发人员。

● 本书也适合渴望不断学习的师生和人工智能爱好者。

本书内容

本书涵盖的章节如下:

第1章数学基础,在该章中,详细讨论线性代数、概率、微积分、优化和机器学习公式的相关数学概念,从而为深度学习奠定数学基础。在讲解了各种概念后,重点是关注它们在机器学习和深度学习领域中的用法。

第2章深度学习概念和TensorFlow介绍,该章介绍深度学习的世界,并讨论了其多年来的发展。详细讲解了神经网络的关键组成部分以及几种学习方法,例如感知器学习规则和反向传播算法。此外,该章还介绍了TensorFlow编码的范例,以便你在转入TensorFlow并涉及更多的实践前熟悉基本语法。

第3章卷积神经网络,该章讨论用于图像处理的卷积神经网络。图像处理是计算机视觉领域的一个重要研究课题,在将卷积神经网络用于对象识别和检测、对象分类、定位和分割等领域后,性能得到了极大的提升。该章首先详细说明卷积的操作,然后继续讲解卷积神经网络的工作原理。重点介绍了卷积神经网络的组成部分,从而为你提供了以有趣的方式进行实验和扩展其网络所需的工具。此外,将详细阐述通过卷积和池化层的反向传播,以帮助你全面了解卷积神经网络的训练过程。该章还介绍了平移同变性和平移不变性的属性,它们对于卷积神经网络的成功至关重要。

第4章基于循环神经网络的自然语言处理,该章讲解使用深度学习进行自然语言处理的内容。首先从用于文本处理的不同向量空间模型开始,之后是词到向量的嵌入模型,例如连续词袋方法和Skip-grm,然后转到涉及循环神经网络、LSTM、门控循环单元和双向循环神经网络的更高级的主题。该章详细介绍了语言建模,以帮助你在涉及该网络的实际问题中利用这些网络。此外,还详细讨论了循环神经网络和LSTM情况下的反向传播机制以及梯度消失问题。

第5章用受限玻尔兹曼机和自编码器进行无监督学习,在该章中,你将学习使用受限玻尔兹曼机和自编码器的深度学习中的无监督方法。另外,该章还将讲解贝叶斯推断和MCMC方法,例如Metropolis算法和吉布斯采样,因为受限玻尔兹曼机训练过程需要一些采样知识。此外,该章还将讨论对比散度,这是吉布斯采样的定制版本,可以对受限玻尔兹曼机进行实际训练。我们将进一步讨论受限玻尔兹曼机如何在推荐系统中用于协作过滤,以及如何在深度置信网络的无监督预训练中使用。

该章后半部分介绍了各种自编码器,例如稀疏自编码器、去噪自编码器等。此外,你还会学习如何将从自编码器中学到的内部特征用于降维以及监督学习。最后,该章简要介绍了数据预处理技术,例如PCA白化和ZCA白化。

第6章高级神经网络,在该章中,你将学习一些高级神经网络,例如全卷积神经网络、U-Net、R-CNN、Fast R-CNN、Faster R-CNN等,处理图像的语义分割、对象检测和定位。该章还将讲解传统的图像分割方法,以便可以适当地结合两个方面的优点。在该章的后半部分,你将学习生成式对抗网络,这是一种用于生成合成数据(如给定分布所生成的数据)的生成模型的新模式。生成式对抗网络在多个领域具有用途和潜力,例如在图像生成、图像修复、抽象推理、语义分割、视频生成、域间样式迁移以及文本到图像生成应用程序等领域。

总而言之,你可以从本书中学到如下主要知识:

● 理解使用TensorFlow的全栈深度学习,并为深度学习奠定坚实的数学基础。

● 使用TensorFlow在产品中部署复杂的深度学习解决方案。

● 进行深度学习研究并使用TensorFlow进行实验。

目录*

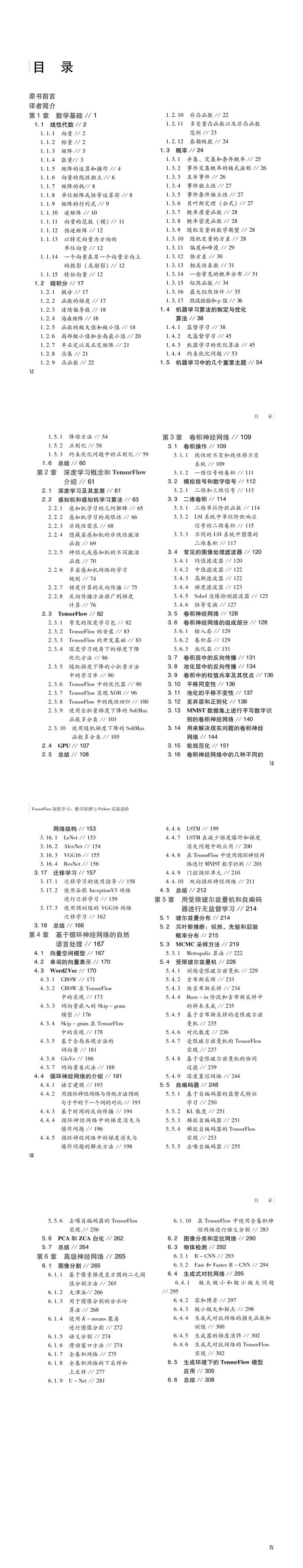

原书前言

第1章 数学基础//1

1.1 线性代数//2

1.1.1 向量//2

1.1.2 标量//2

1.1.3 矩阵//3

1.1.4 张量//3

1.1.5 矩阵的运算和操作//4

1.1.6 向量的线性独立//6

1.1.7 矩阵的秩//8

1.1.8 单位矩阵或恒等运算符//8

1.1.9 矩阵的行列式//9

1.1.10 逆矩阵//10

1.1.11 向量的范数(模)//11

1.1.12 伪逆矩阵//12

1.1.13 以特定向量为方向的单位向量//12

1.1.14 一个向量在另一个向量方向上的投影(或射影)//12

1.1.15 特征向量//12

1.2 微积分//17

1.2.1 微分//17

1.2.2 函数的梯度//17

1.2.3 连续偏导数//18

1.2.4 海森矩阵//18

1.2.5 函数的极大值和极小值//18

1.2.6 局部极小值和全局最小值//20

1.2.7 半正定以及正定矩阵//21

1.2.8 凸集//21

1.2.9 凸函数//22

1.2.10 非凸函数//22

1.2.11 多变量凸函数以及非凸函数范例//23

1.2.12 泰勒级数//24

1.3 概率//24

1.3.1 并集、交集和条件概率//25

1.3.2 事件交集概率的链式法则//26

1.3.3 互斥事件//26

1.3.4 事件独立性//27

1.3.5 事件条件独立性//27

1.3.6 贝叶斯定理(公式)//27

1.3.7 概率质量函数//28

1.3.8 概率密度函数//28

1.3.9 随机变量的数学期望//28

1.3.10 随机变量的方差//28

1.3.11 偏度和峰度//29

1.3.12 协方差//30

1.3.13 相关性系数//31

1.3.14 一些常见的概率分布//31

1.3.15 似然函数//34

1.3.16 最大似然估计//35

1.3.17 假设检验和p值//36

1.4 机器学习算法的制定与优化算法//38

1.4.1 监督学习//38

1.4.2 无监督学习//45

1.4.3 机器学习的优化算法//45

1.4.4 约束优化问题//53

1.5 机器学习中的几个重要主题//54

1.5.1 降维方法//54

1.5.2 正则化//5

1.5.3 约束优化问题中的正则化//59

1.6 总结//60

第2章 深度学习概念和TensorFlow介绍//61

2.1 深度学习及其发展//61

2.2 感知机和感知机学习算法//63

2.2.1 感知机学习的几何解释//65

2.2.2 感知机学习的局限性//66

2.2.3 非线性需求//68

2.2.4 隐藏层感知机的非线性激活函数//69

2.2.5 神经元或感知机的不同激活函数//70

2.2.6 多层感知机网络的学习规则//74

2.2.7 梯度计算的反向传播//75

2.2.8 反向传播方法推广到梯度计算//76

2.3 TensorFlow //82

2.3.1 常见的深度学习包//82

2.3.2 TensorFlow的安装//83

2.3.3 TensorFlow的开发基础//83

2.3.4 深度学习视角下的梯度下降优化方法//86

2.3.5 随机梯度下降的小批量方法中的学习率//90

2.3.6 TensorFlow中的优化器//90

2.3.7 TensorFlow实现XOR//96

2.3.8 TensorFlow中的线性回归//100

2.3.9 使用全批量梯度下降的SoftMax函数多分类//103

2.3.10 使用随机梯度下降的SoftMax函数多分类//105

2.4 GPU //107

2.5 总结//108

第3章 卷积神经网络//109

3.1 卷积操作//109

3.1.1 线性时不变和线性移不变系统//109

3.1.2 一维信号的卷积//111

3.2 模拟信号和数字信号//112

3.2.1 二维和三维信号//113

3.3 二维卷积//114

3.3.1 二维单位阶跃函数//114

3.3.2 LSI系统中单位阶跃响应信号的二维卷积//115

3.3.3 不同的LSI系统中图像的二维卷积//117

3.4 常见的图像处理滤波器//120

3.4.1 均值滤波器//120

3.4.2 中值滤波器//122

3.4.3 高斯滤波器//122

3.4.4 梯度滤波器//123

3.4.5 Sobel边缘检测滤波器//125

3.4.6 恒等变换//127

3.5 卷积神经网络//128

3.6 卷积神经网络的组成部分//128

3.6.1 输入层//129

3.6.2 卷积层//129

3.6.3 池化层//131

3.7 卷积层中的反向传播//131

3.8 池化层中的反向传播//134

3.9 卷积中的权值共享及其优点//136

3.10 平移同变性//136

3.11 池化的平移不变性//137

3.12 舍弃层和正则化//138

3.13 MNIST数据集上进行手写数字识别的卷积神经网络//140

3.14 用来解决现实问题的卷积神经网络//144

3.15 批规范化//151

3.16 卷积神经网络中的几种不同的网络架构//153

3.16.1 LeNet//153

3.16.2 AlexNet//154

3.16.3 VGG16//155

3.16.4 ResNet//156

3.17 迁移学习//157

3.17.1 迁移学习的使用指导//158

3.17.2 使用谷歌InceptionV3网络进行迁移学习//159

3.17.3 使用预训练的VGG16网络迁移学习//162

3.18 总结//166

第4章 基于循环神经网络的自然语言处理//167

4.1 向量空间模型//167

4.2 单词的向量表示//170

4.3 Word2Vec//170

4.3.1 CBOW //171

4.3.2 CBOW 在TensorFlow中的实现//173

4.3.3 词向量嵌入的Skip-gram模型//176

4.3.4 Skip-gram在TensorFlow中的实现//178

4.3.5 基于全局共现方法的词向量//181

4.3.6 GloVe//186

4.3.7 词向量类比法//188

4.4 循环神经网络的介绍//191

4.4.1 语言建模//193

4.4.2 用循环神经网络与传统方法预测句子中的下一个词的对比//193

4.4.3 基于时间的反向传播//194

4.4.4 循环神经网络中的梯度消失与爆炸问题//196

4.4.5 循环神经网络中的梯度消失与爆炸问题的解决方法//198

4.4.6 LSTM//199

4.4.7 LSTM在减少梯度爆炸和梯度消失问题中的应用//200

4.4.8 在TensorFlow中使用循环神经网络进行MNIST数字识别//201

4.4.9 门控循环单元//210

4.4.10 双向循环神经网络//211

4.5 总结//212

第5章 用受限玻尔兹曼机和自编码器进行无监督学习//214

5.1 玻尔兹曼分布//214

5.2 贝叶斯推断:似然、先验和后验概率分布//215

5.3 MCMC采样方法//219

5.3.11 Metropolis算法//222

5.4 受限玻尔兹曼机//226

5.4.1 训练受限玻尔兹曼机//229

5.4.2 吉布斯采样//233

5.4.3 块吉布斯采样//234

5.4.4 Burn-in阶段和吉布斯采样中的样本生成//235

5.4.5 基于吉布斯采样的受限玻尔兹曼机//235

5.4.6 对比散度//236

5.4.7 受限玻尔兹曼机的TensorFlow实现//237

5.4.8 基于受限玻尔兹曼机的协同过滤//239

5.4.9 深度置信网络//244

5.5 自编码器//248

5.5.1 基于自编码器的监督式特征学习//250

5.5.2 KL散度//251

5.5.3 稀疏自编码器//251

5.5.4 稀疏自编码器的TensorFlow实现//253

5.5.5 去噪自编码器//255

5.5.6 去噪自编码器的TensorFlow实现//256

5.6 PCA和ZCA白化//262

5.7 总结//264

第6章 高级神经网络//265

6.1 图像分割//265

6.1.1 基于像素强度直方图的二元阈值分割方法//265

6.1.2 大津法//266

6.1.3 用于图像分割的分水岭算法//268

6.1.4 使用K-means聚类进行图像分割//272

6.1.5 语义分割//274

6.1.6 滑动窗口方法//274

6.1.7 全卷积网络//275

6.1.8 全卷积网络的下采样和上采样//277

6.1.9 U-Net//281

6.1.10 在TensorFlow中使用全卷积神经网络进行语义分割//283

6.2 图像分类和定位网络//290

6.3 物体检测//292

6.3.1 R-CNN//293

6.3.2 Fast和Faster-CNN//294

6.4 生成式对抗网络//295

6.4.1 极大极小和极小极大问题//295

6.4.2 零和博弈//297

6.4.3 极小极大和鞍点//298

6.4.4 生成式对抗网络的损失函数和训练//300

6.4.5 生成器的梯度消弭//302

6.4.6 生成式对抗网络的TensorFlow实现//302

6.5 生成环境下的TensorFlow模型应用//305

6.6 总结//308

- 机械工业出版社旗舰店 (微信公众号认证)

- 扫描二维码,访问我们的微信店铺

- 随时随地的购物、客服咨询、查询订单和物流...