官网 ChatGPT原理与实战 大型语言模型的算法 技术和私有化 刘聪 智能系统与技术丛书 ChatGPT起源工作原理技术书籍

| 运费: | ¥ 0.00-30.00 |

商品详情

书名:ChatGPT原理与实战:大型语言模型的算法、技术和私有化

定价:99.0

ISBN:9787111733034

作者:刘聪

版次:1

内容提要:

这是一本系统梳理并深入解析ChatGPT核心技术、算法实现、工作原理、训练方法的著作,

也是一本能指导你搭建专属ChatGPT和实现大模型迁移及私有化的著作。

本书得到了MOSS系统负责人邱锡鹏等多位专家的高度评价和鼎力推荐。

具体地,通过本书你能了解或掌握以下知识:

ChatGPT的工作流程和技术栈

ChatGPT的工作原理和算法实现

基于Transformer架构的一系列预训练语言模型的原理

强化学习的基础知识

提示学习与大模型涌现出的上下文学习、思维链

大模型的训练方法及常见的分布式训练框架

基于人工反馈的强化学习整体框架

从零搭建类ChatGPT模型,模拟完整的ChatGPT训练过程

本书集理论、实战和产业应用于一体,提供大量经详细注释的代码,方便读者理解和实操。

不管里是想深入研究ChatGPT本身,还是正在研发或使用其他大模型,

本书都应该能给你颇具价值的技术启发与思考,让你在大模型的路上快速前行,少走弯路。

目录:

CONTENTS

目 录

赞誉

前言

第1章 了解ChatGPT1

1.1 ChatGPT的由来1

1.1.1 什么是ChatGPT2

1.1.2 ChatGPT的发展历史2

1.2 ChatGPT的工作流程3

1.3 ChatGPT用例3

1.3.1 日常任务4

1.3.2 编写代码5

1.3.3 文本生成6

1.3.4 办公自动化9

1.4 本章小结10

第2章 ChatGPT原理解构11

2.1 背景知识11

2.1.1 自然语言处理的发展历程12

2.1.2 大型语言模型的发展历程14

2.2 ChatGPT同类产品18

2.2.1 BlenderBot 3.018

2.2.2 LaMDA20

2.2.3 Sparrow23

2.3 ChatGPT的工作原理25

2.3.1 预训练与提示学习阶段26

2.3.2 结果评价与奖励建模阶段28

2.3.3 强化学习与自我进化阶段28

2.4 算法细节29

2.4.1 标注数据29

2.4.2 建模思路30

2.4.3 存在的问题30

2.5 关于ChatGPT的思考31

2.6 本章小结32

第3章 预训练语言模型33

3.1 Transformer结构33

3.2 基于Encoder结构的模型36

3.2.1 BERT36

3.2.2 RoBERTa39

3.2.3 ERNIE40

3.2.4 SpanBERT42

3.2.5 MacBERT43

3.2.6 ALBERT44

3.2.7 NeZha45

3.2.8 UniLM46

3.2.9 GLM47

3.2.10 ELECTRA48

3.3 基于Decoder结构的模型49

3.3.1 GPT49

3.3.2 CPM51

3.3.3 PaLM51

3.3.4 OPT52

3.3.5 Bloom53

3.3.6 LLaMA54

3.4 基于Encoder-Decoder结构的模型55

3.4.1 MASS55

3.4.2 BART56

3.4.3 T557

3.5 基于夸夸闲聊数据的UniLM

模型实战59

3.5.1 项目简介59

3.5.2 数据预处理模块59

3.5.3 UniLM模型模块63

3.5.4 模型训练模块65

3.5.5 模型推理模块72

3.6 本章小结76

第4章 强化学习基础77

4.1 机器学习的分类77

4.1.1 有监督学习78

4.1.2 无监督学习78

4.1.3 强化学习79

4.2 OpenAI Gym82

4.2.1 OpenAI Gym API简介83

4.2.2 环境简介84

4.3 强化学习算法85

4.3.1 Q-learning算法85

4.3.2 SARSA算法87

4.3.3 DQN算法89

4.3.4 Policy Gradient算法93

4.3.5 Actor-Critic算法95

4.4 本章小结98

第5章 提示学习与大型语言

模型的涌现99

5.1 提示学习99

5.1.1 什么是提示学习100

5.1.2 提示模板设计100

5.1.3 答案空间映射设计102

5.1.4 多提示学习方法103

5.2 上下文学习104

5.2.1 什么是上下文学习104

5.2.2 预训练阶段提升上下文

学习能力105

5.2.3 推理阶段优化上下文

学习的效果107

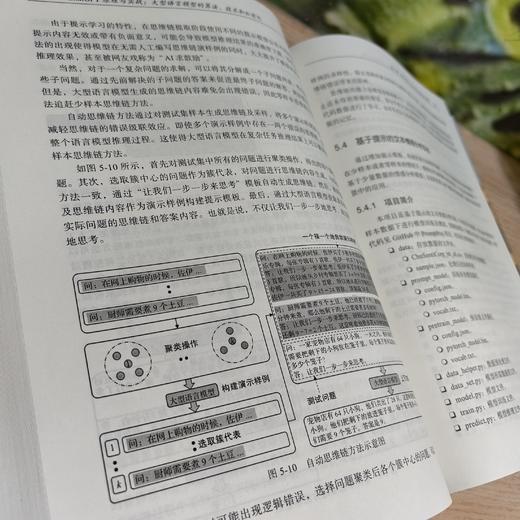

5.3 思维链108

5.4 基于提示的文本情感分析实战113

5.4.1 项目简介113

5.4.2 数据预处理模块114

5.4.3 BERT模型模块115

5.4.4 模型训练模块118

5.4.5 模型推理模块128

5.5 本章小结131

第6章 大型语言模型预训练132

6.1 大型预训练模型简介132

6.2 预训练模型中的分词器133

6.2.1 BPE133

6.2.2 WordPiece135

6.2.3 Unigram136

6.2.4 SentencePiece137

6.3 分布式深度学习框架138

6.3.1 并行范式简介139

6.3.2 Megatron-LM145

6.3.3 DeepSpeed147

6.3.4 Colossal-AI149

6.3.5 FairScale152

6.3.6 ParallelFormers153

6.3.7 OneFlow153

6.4 基于大型语言模型的预训练实战155

6.4.1 项目简介155

6.4.2 数据预处理模块156

6.4.3 执行模型训练159

6.5 基于大型语言模型的信息

抽取实战168

6.5.1 项目简介168

6.5.2 数据预处理模块169

6.5.3 Freeze微调模块172

6.5.4 LoRA微调模块176

6.5.5 P-Tuning v2微调模块181

6.6 本章小结186

第7章 GPT系列模型分析187

7.1 GPT-1~GPT-4系列模型分析187

7.1.1 GPT-1和GPT-2模型187

7.1.2 GPT-3模型189

7.1.3 GPT-3的衍生模型:

Code-X192

7.1.4 GPT-4模型193

7.2 InstructGPT模型分析194

7.2.1 模型简介194

7.2.2 数据收集195

7.2.3 模型原理198

7.2.4 模型讨论199

7.3 基于GPT-2模型的文本摘要实战200

7.3.1 项目简介200

7.3.2 数据预处理模块200

7.3.3 GPT-2模型模块202

7.3.4 模型训练模块204

7.3.5 模型推理模块213

7.4 本章小结219

第8章 PPO算法与RLHF理论实战220

8.1 PPO算法简介220

8.1.1 策略梯度算法回顾220

8.1.2 PPO算法原理剖析222

8.1.3 PPO算法对比与评价224

8.2 RLHF框架简介226

8.2.1 RLHF内部剖析226

8.2.2 RLHF价值分析228

8.2.3 RLHF问题分析229

8.3 基于PPO的正向情感倾向性

生成项目实战230

8.3.1 项目任务与数据集分析230

8.3.2 数据预处理模块230

8.3.3 模型训练模块232

8.3.4 模型生成模块234

8.3.5 模型评估模块235

8.4 问题与思考237

8.5 本章小结238

第9章 类ChatGPT实战239

9.1 任务设计239

9.2 数据准备240

9.3 基于文档生成问题任务的类

ChatGPT实战241

9.3.1 SFT阶段241

9.3.2 RM阶段249

9.3.3 RL阶段259

9.4 本章小结270

第10章 ChatGPT发展趋势271

10.1 AIGC的发展趋势271

10.1.1 AI云边协同272

10.1.2 AI工具应用273

10.1.3 AI可控生成274

10.1.4 AI辅助决策275

10.2 ChatGPT 2C应用场景276

10.2.1 个人助手276

10.2.2 知识导师278

10.2.3 创意集市279

10.2.4 情感伴侣282

10.3 ChatGPT 2B应用场景283

10.3.1 智能客服283

10.3.2 办公助手285

10.3.3 软件研发287

10.3.4 决策辅助288

10.4 行业参考建议290

10.5 本章小结291

- 机械工业出版社旗舰店 (微信公众号认证)

- 扫描二维码,访问我们的微信店铺

- 随时随地的购物、客服咨询、查询订单和物流...