商品详情

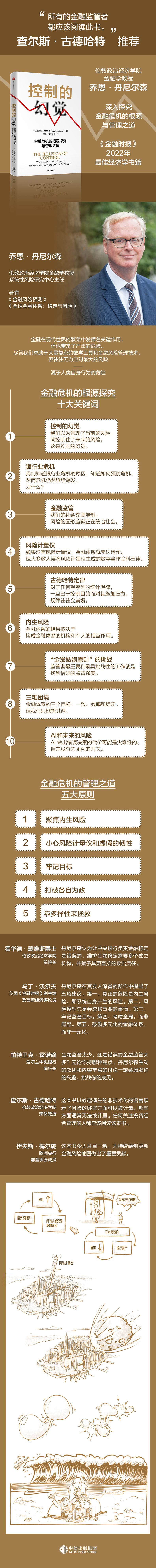

书名: 控制的幻觉

定价: 69.00

作者: 乔恩·丹尼尔森

出版社: 中信出版集团

出版日期: 2023-08-02

页码: 348

装帧: 假精装

开本: 16

ISBN: 9787521757002

一本讲述金融危机、金融风险为什么会发生、如何衡量风险,以及用多样化金融体系来应对金融危机的书。既回应了欧美银行业危机等现实问题,也前瞻了人工智能与银行监管等未来难题。

这本书挑战了金融风险领域的传统智慧,解释了以简单的方案管控金融体系为何注定会失败。

金融在现代世界的繁荣中发挥着关键作用,也带来了严重的危险。为管理这些威胁,我们求助于大量复杂的数学工具和金融风险管理技术。然而在更多时候,我们无力应对大的风险——源于人类自身行为的危险。

这本书认为核心风险产生于体系内部,生发于个体之间的相互作用,并因无数个体的信仰、目标、能力和偏见而永久存在。人们普遍认为风险源于金融体系之外,这一错觉削弱了我们度量和管理风险的能力,同时,新的监管法规可能有助于降低小规模风险的水平,但反而鼓励过度的风险承担。书中援引过去和近的危机教训,说明多样性是保护金融体系的佳方式。

导 读 003

一章 驾驭老虎 001

第二章 系统性风险 009

第三章 土拨鼠之日 033

第四章 风险的圆形监狱 061

第五章 风险计量仪的迷思 087

第六章 想法很重要:风险和不确定性 113

第七章 内生风险 131

第八章 如果你不能承担风险,请更换风险计量仪 155

第九章 “金发姑娘原则”的挑战 179

第十章 风险表演 203

第十一章 一致、效率和稳定的三难困境 229

第十二章 鲍勃的故事:机器人和未来风险 249

第十三章 不该走的路 271

第十四章 该怎么办 293

致 谢 311

注 释 313

参考文献 319

译后记 327

乔恩·丹尼尔森

伦敦政治经济学院金融学教授,系统性风险研究中心主任,著有《金融风险预测》《全球金融体系:稳定与风险》。

第十二章

鲍勃的故事:机器人和未来风险

AI是什么

计算机说不。——卡萝尔·比尔

关于AI的文章已经有很多,这里没有要重复介绍。我强烈荐斯图尔特·罗素的《AI新生:破解人机共存密码——人类后一个大问题》这本书。但我想阐述一下我的立场,所以请耐心听我说。AI背后的理念是计算机通过了解世界的种种来独立决策。它能做像玩游戏一样简单的事情,也能完成像开车一样复杂的事情,它甚至可以监管金融体系。对AI进行描述并不简单,甚至连专家也无法达成共识。先从机器学习开始说,机器学习是一种计算机算法,使用可用数据来了解产生这些数据的世界。这种算法研究有规律和复杂的因果关系。神奇的是,它可以在没有人为干预的情况下做到这一点,即无监督学习。这与我们通常从事科学研究的方式不同。一般的做法是,我们首先对世界运行的可能方式提出一些想法(某种理论),然后看看数据是否与该理论相容。

一家超市可以用机器学习算法来确定店内销售可口可乐的佳位置,以实现销量大化。数据科学家通常需要收集可口可乐的销量、天气和人口统计等历史数据。他用机器学习算法处理这些数据,然后告知超市货架上销售可口可乐的佳位置。这将涉及大量的数据。对于像沃尔玛这样的连锁零售商来说,这通常意味着万亿条数据,即所谓的大数据。关键的是,机器学习算法不需要了解关于可口可乐或超市的任何信息,而只需要获取销售相关数据并发现规律即可。

但天下没有免费的午餐,有得就有失。机器学习需要大量的数据,远远超过大多数统计应用所需要的。它需要大数据,因为它对世界一无所知,所以须从数据中学习一切。相比之下,人类了解世界,可以用先前掌握的信息,包括文化、经济、历史等来解决问题,因此需要的数据要少得多。我们了解理论,所以小数据集就可以满足传统统计工具的需求。

机器学习为的是从数据集中提取信息,而AI的目标是基于这些数据做出决策。如今,AI已经被用来做很多决定。在21世纪初的一部英国喜剧《小不列颠》中,有一幕反复出现——银行信贷职员卡萝尔·比尔每次面对客户的问询,他都在电脑上打字,然后回答:“计算机说不。”即使是对合理的要求也是如此。

不过,AI这个词有点用词不当。当下AI的智能和人类的聪明不一样。它只知道很多假设性的指令。比如,如果交通信号灯红灯闪烁,司机就停下来;如果绿灯闪烁,司机就看看交通状况再走。AI在某种程度上想要复制人类的大脑。人类大脑平均有860亿个神经元,它们通过突触相互连接,形成神经网络。理论上,一台拥有足够多人工神经元的计算机,若以同样的方式连接起来,就可以变得智能。但我们还没到那个阶段。现在AI的智能还只停留在普通昆虫的水平,比如蟑螂。它们是较聪明的昆虫之一,能够学习和适应环境,甚至还被认为是一一种能在核战争中幸存的动物。它们不是具社会性的动物,但确实表现出复杂的社会行为。AI还没有赶上蟑螂。用理论物理学家加来道雄的话来说,“目前,我们先的机器人加起来的智能和智慧与一只蟑螂相当,还是大脑迟钝的蟑螂,一只被切除额叶的智障蟑螂”。1

以英特尔联合创始人戈登·摩尔的名字命名的摩尔定律指出,一个芯片中的晶体管数量每18个月会翻一番。这个定律有用吗?与我辩论的那位技术爱好者所提倡的就是这个定律。我读博士时,曾在一台2 700万美元的Cray Y-MP超级计算机上运行过计算机代码。当时我们要排队使用这台计算机,一个经济学博士生的需求也得不到优先满足。但我了解到周日排队的人不多,所以我周日早上4点起床去办公室,就可以独享这台计算机一段时间了。我经常这样做。我近在巴黎的时候,在科学博物馆看到了一台Cray Y-MP超级计算机。我口袋里苹果手机的运行速度是这台计算机的很多倍。从我出生前到现在,计算速度一直呈指数级增长,而且没有放缓的迹象。

摩尔定律能帮助AI赶上人类智力吗?简短的回答是否定的。摩尔定律是有关计算速度的增长,但AI追赶人类的问题不在于速度,而在于概念。不管计算机有多快,现在的AI算法的质量根本无法帮助我们走得很远。然而,突破可能会在一夜之间发生,有人可能已经想出了一种全新的算法,让AI超越人类。但这一切可能永远也不会发生。

专家称这种可能性为技术奇点,一些人认为这并不遥远。谷歌的工程总监雷·库兹韦尔表示:“2029年是我一直预测的年份,届时AI将通过有效的图灵测试,从而达到人类的智能水平。我把2045年定为‘奇点’年份,到那时,通过与我们创造的智能相结合,我们的有效智能可以实现10亿倍的增长。”

然而,我们并不需要到达奇点才能让AI发挥作用。AI不需要达到人类智能的水平,甚至不需要蟑螂或蚂蚁智能的水平才能有用。问题越具体,AI的表现就越好。所以,AI擅长玩规则已知且目标明确的游戏。近一个著名的AI应用是谷歌的阿尔法元,它只接受了关于围棋游戏规则的指导,就能在三天的时间里学会如何战胜它的前身阿尔法狗,后者早些时候击败了围棋世界冠军。

擅长玩复杂的游戏就意味着擅长做其他事情吗?很多人都这么认为。苏联人很尊敬本国的棋手,认为如果一个人能够掌握国际象棋的复杂策略,就应该能够管理中央计划经济或在战争中取胜。列宁是一个厉害的棋手,斯大林更是如此。然而,擅长下棋的AI更像一个白痴神童,就像电影《雨人》中的主角一样。擅长下棋并不能说明它是否有做其他事情的能力,比如监管金融体系或驾驶汽车。在像国际象棋这样的游戏中,玩家可以采取的行动数量事先是确定的,并且有关于游戏状态的信息对玩家来说都是可见的。用博弈论的语言来说:信息是完整的,行动空间是有限的。

这也是AI可以(在一定程度上)驾驶汽车的原因:有很多信息可供AI学习,规则易于理解而且不会有太大变化。即便如此,AI也只能在高速公路上行驶,而且天气不能太糟糕。AI是不可能在城市里开车的,更不用说在大雪天有交通标志都看不清楚的时候驾驶。也许对驾驶汽车的AI来说,大的挑战是人类。人类是不可预测的,我们的行为方式可能会让自动驾驶汽车感到不安。所以,一些AI设计师提议对人类行为进行重新规范。3

当AI面对的不再是棋盘游戏和高速公路驾驶这样具体的任务时,它的表现就会变差。它不擅长玩那些信息不完整、行动空间不明确的游戏。我认为它不会在我喜欢的游戏《外交》中有很好的表现。我曾经和几个朋友在网上玩《外交》,其中一位是政客。他毫不费力地击败了我们,表现出其他选手所没有的狡猾和策略。我觉得人工智能在短时间内不可能打败他。如果规则在游戏过程中发生变化,那么AI面临的挑战就更大了,但大多数人类活动都会出现规则的变化。

我自己有一个检验机器人和AI的测试。我可以付给一个从未来过我家的人100美元来帮我洗衣服。他来到我的大学办公室,我给他钱、钥匙和我家地址。他找到我家,进去找到我的洗衣篮和洗衣机,弄清楚如何操作机器,在哪里可以找到洗涤剂。他洗好衣服,放进衣柜,离开,把钥匙从我家门上塞邮件的缝里塞进去。在做这一切的过程中,他都不需要任何解释或指示。这种技术存在的时间比我的年龄还长。要是AI有一天可以做到这一点,那我将相当钦佩。

英格兰银行的机器人:鲍勃

几年前,英格兰银行首席经济学家安迪·霍尔丹设想了一种控制金融体系的新方法,监管者将“近乎实时地(想象一下他们坐在《星际迷航》中的椅子上,使用一组监视器)跟踪全球资金流动,就像监控全球天气系统和全球互联网流量一样。他们关注的是全球金融流动图”。4我们就把这个监管者称为鲍勃,全称英格兰银行机器人(见图12-1)。鲍勃是监管英国金融体系的未来AI。鲍勃将收集有的数据和人类行为,并用它们来识别有的突发事件,识别脆弱性、低效和系统性风险。进一步假设,其他主要金融中心也开发了自己版本的鲍勃,比如弗兰和伊迪斯,而且有AI都展开友好合作。各个金融机构也将有自己的AI,比如格斯、玛丽和贝蒂等。这是一个注定要失败的不切实的未来愿景,就像20世纪70年代的飞行汽车一样吗?不。虽然鲍勃和它的其他AI朋友还不存在,但是创造它们的技术已经存在了,大部分都存在了,我们缺乏的只是意愿。

微观审慎监管机构已有机器人监管者。监管科技(RegTech)——其英文为监管(Regulation)和技术(Technology)两个单词的缩写——成了备受关注的流行词。其主要支持者英国金融行为监管局将监管科技定义为“使用新技术来促进监管要求的实施”。在过去的几年里,我参与了英国金融行为监管局、我所在的研究中心和其他感兴趣的各方进行的一个联合监管科技研究项目。

一切从规则手册开始。如果把有监管规则和法规打印出来,打印出来的纸张会有两米高。英国金融行为监管局已将规则输入AI引擎,以检查规则是否存在矛盾之处,并提供更快、更好的建议。与英国金融行为监管局机器人通信的金融机构发现,它的回答比人类同事好得多。AI也正在彻底改变银行的风险管理。建立风险管理AI的一步是开发和管理风险测量方法,这对AI来说是一项简单的任务。它可以快速学习有已批准的模型,数据可以很容易获得,并且设计风险测量方法也很容易。如今,许多金融机构的AI引擎正是这样做的。然后,AI需要了解一家银行的有投资,以及做出这些投资的个人。这样,我们就有了一个可以正常运行的风险管理AI。要的信息已经储存在银行的信息技术基础设施中,风险管理过程中也不存在不可逾越的技术障碍。如果有,就使用阿拉丁系统或风险计量系统来克服。这样做将节省巨大的成本。银行可以用AI取代大多数风险建模师、风险经理和合规官。技术已经存在了,剩下要做的就是将银行的高层目标告知AI。然后,AI就可以自动管理风险,建议谁被解雇或获得奖金,并就如何投资提出建议。

风险管理和微观审慎监管是AI的理想用途——利用大量结构化数据确保明确的规则和流程得到遵守。它们可以接触到有关人类行为的监测数据,得到精确的高层目标的指导,并产生可以直接观察到的结果。就像玩游戏的应用场景一样,监管场景中的信息大多是完整的,而行动空间是有限的。虽然还有一定差距,但技术进步的轨迹让我们深信AI有一天可以完全实现当前的许多功能。我们面临的主要障碍不是技术,而是在法律、政治和社会方面的考虑。

但是宏观审慎监管是一个不同领域的问题,因为AI在该领域实现良好表现的有先决条件都不存在。数据是稀缺的,宏观审慎监管涉及的事件大多是独特且偶发的。毕竟,经合组织成员平均每43年才会遭遇一次系统性危机,所以可供AI训练的数据很少。更糟糕的是,监管当局和私人机构从过去的危机中吸取教训,往往不会重复犯错,但是会制造出新的错误,使AI无法应对。在近的一篇论文《人工智能和系统性风险》(本章其余部分基于该研究)中,我与两位合作者罗伯特·麦克雷和安德烈亚斯·乌特曼一起研究了AI执行宏观审慎政策所面临的主要问题。我们认为有四个方面需要特别关注:顺周期性、未知的未知因素、缺乏信任,以及反系统的优化。

银行业本质上是顺周期的。银行在经济景气时自由放贷,刺激了繁荣;而当形势恶化时,它们反过来又收缩放贷,导致信贷紧缩。现代金融法规和风险管理实践对风险计量仪和风险仪表盘的依赖,进一步加剧了顺周期性。风险计量仪查看近期的历史价格数据,如果数据看起来稳定,那么风险计量仪的风险读数就低。问题在于,价格数据在上涨时往往比在下跌时更稳定,任何回顾式的、数据驱动的过程,包括AI背后的机器学习过程,都将认为在市场平静时期风险较低,在危机之后较高,所以测量风险过程本身就是顺周期的。我们对风险计量仪输出结果的使用也是顺周期的。这些结果会影响风险控制系统和监管,因此那些负责风险投资决策的业务经理、信贷员及交易员也会放大金融周期。当然,这并非源于AI本身的问题。但我认为,由于AI以特殊的方式与风险测量和管理产生相互作用,这个问题变得更加严重。

金融机构和监管机构的AI引擎都可以使用相同的数据和机器学习技术,都拥有重要的计算资源。各种AI引擎将不可避免地以比人类风险建模者更快的速度选择同一个风险计量仪,从而实现知识的统一。AI还将统一行动,协调金融机构对新信息的反应。它比人类更能理解佳实践,知道应该做什么,不该做什么。AI将推动银行以同样的方式管理风险。有这些都是顺周期的,因为它们与银行的客观功能相互作用,在已有限制下实现利润大化。各家银行获得的信息越相似,它们的解决方案就越接近。这意味着出现拥挤交易,金融周期被放大。归根结底,AI之所以具有顺周期属性,是因为它倾向于单一栽培。由于AI比人类风险管理人员拥有更多的信息,因此从整个行业来看,它荐的解决方案会变得越来越相似。但即便如此,如果没有有外部约束(重要的是监管法规),AI也不一定是顺周期的。监管法规和AI之间的相互反馈,是单一栽培和系统性风险危险的驱动因素。

如果我们要求AI管理金融稳定,那它会去哪里寻找危险?从事后来看,2008年金融危机有很多预警信号,许多人批评人类监管者错过了有这些信号。AI能做得更好吗?不太可能。对于基于次级抵押贷款开发结构性信贷产品并为其提供隐形流动性担保的做法,如果没有对其在多个行政辖区、不同类别机构和国家产生的后果进行观察和总结,那么AI就无法进行学习。可以想象,在2008年,一个设计良好的AI引擎可能已经注意到房价、抵押贷款违约和违约相关性(决定CDOs价格的几个因素)之间的联系。它还可能意识到流动性蒸发时结构性信贷产品的脆弱性。但是,即使AI识别出了每一个单独的元素,它将有元素组合在一起的可能性也相当低,而这是发现体系的一系列脆弱性所需的。这对AI、银行和各国金融当局都提出了很高的要求,各国金融当局须允许数据驱动式的国际监管深度介入各国的数据和监管中。

能否成功发现金融体系中的系统性风险,取决于脆弱性在哪里。有充分经济理论支撑的日常因素会驱动金融危机出现。然而,每个危机事件的底层细节通常都是独特的。每次危机过后,监管者和金融机构都会吸取教训,调整流程,避免再犯同样的错误。

- 中信出版社

- 中信出版社坚持“我们提供知识,以应对变化的世界”的出版理念,以高端优质的内容服务,多样化的内容展现形式,为读者提供高品质阅读与视听内容,满足大众多样化的知识与文化需求。

- 扫描二维码,访问我们的微信店铺