商品详情

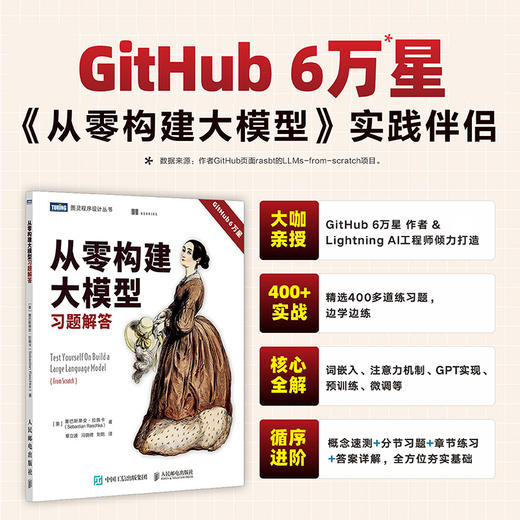

书名:从*构建大模型习题解答

定价:59.8

ISBN:9787115679499

作者:[美]塞巴斯蒂安·拉施卡(Sebastian Raschka)

版次:第1版

出版时间:2025-09

内容提要:

本书是《从*构建大模型》一书的配套习题,旨在通过多种练习和自我评估方式,帮助读者巩固和深化对大语言模型构建过程的理解。书中内容围绕《从*构建大模型》一书的结构展开,覆盖代码和主要概念问题、批判性思维练习、单项选择题以及答案解析等内容。建议读者在阅读《从*构建大模型》一书之前、之后以及复习阶段使用本书,通过重复学习的方式巩固知识,并将其与已有的知识体系相融合。

作者简介:

塞巴斯蒂安·拉施卡(Sebastian Raschka) *影响力的人工智能*,GitHub项目LLMs-from-scratch的星标数达4万。现在大模型独角兽公司Lightning AI任*研究工程师。博士毕业于密歇根州立大学,2018~2023年威斯康星大学麦迪逊分校助理教授(终身教职),从事深度学习科研和教学。除本书外,他还写作了*书《大模型技术30讲》和《Python机器学习》。

目录:

第 1 章 理解大语言模型 1

主要概念速测 1

分节习题 3

11 什么是大语言模型 3

12 大语言模型的应用 4

13 构建和使用大语言模型的各个

阶段 5

14 Transformer 架构介绍 5

15 利用大型数据集 6

16 深入剖析GPT 架构 7

17 构建大语言模型 9

答案 11

第 2 章 处理文本数据 18

主要概念速测 18

分节习题 20

21 理解词嵌入 20

22 文本分词 20

23 将词元转换为词元ID 21

24 引入特殊上下文词元 22

25 BPE 23

26 使用滑动窗口进行数据采样 24

27 创建词元嵌入 26

28 编码单词位置信息 27

章节练习 28

答案 29

第3 章 编码注意力机制 38

主要概念速测 38

分节习题 40

31 长序列建模中的问题 40

32 使用注意力机制捕获数据依赖

关系 41

33 通过自注意力机制关注输入的

不同部分 41

34 实现带可训练权重的自注意力

机制 43

35 利用因果注意力隐藏未来词汇 44

36 将单头注意力扩展到多头注意力 45

章节练习 47

答案 48

第4 章 从头实现GPT 模型进行文本

生成 54

主要概念速测 54

分节习题 56

41 构建一个大语言模型架构 56

42 使用层归一化进行归一化* 58

43 实现具有GELU *函数的

前馈神经网络 59

44 添加快捷连接 60

45 连接Transformer 块中的注意力层

和线性层 61

46 实现GPT 模型 62

47 生成文本 63

章节练习 64

答案 65

第5 章 在无标签数据上进行预训练 74

主要概念速测 74

分节习题 76

51 评估文本生成模型 76

52 训练大语言模型 78

53 控制随机性的解码策略 79

54 使用PyTorch 加载和保存模型

权重 80

55 从OpenAI 加载预训练权重 81

章节练习 81

答案 83

第6 章 针对分类的微调 91

主要概念速测 91

分节习题 93

61 不同类型的微调 93

62 准备数据集 94

63 创建数据加载器 95

64 初始化带有预训练权重的模型 97

65 添加分类头 97

66 计算分类损失和*率 97

67 在有监督数据上微调模型 98

68 使用大语言模型作为垃圾消息

分类器 100

章节练习 101

答案 102

第7 章 通过微调遵循人类指令 110

主要概念速测 110

分节习题 112

71 指令微调介绍 112

72 为有监督指令微调准备数据集 112

73 将数据组织成训练批次 113

74 创建指令数据集的数据加载器 114

75 加载预训练的大语言模型 116

76 在指令数据上微调大语言模型 116

77 抽取并保存模型回复 117

78 评估微调后的大语言模型 117

章节练习 118

答案 119

附录A PyTorch 简介 129

问题 129

答案 132

附录B 参考文献和延伸阅读 136

附录C 练习的解决方案 137

附录D 为训练循环添加更多细节和

优化功能 138

问题 138

答案 139

附录E 使用LoRA 进行参数*微调 140

问题 140

答案 142

定价:59.8

ISBN:9787115679499

作者:[美]塞巴斯蒂安·拉施卡(Sebastian Raschka)

版次:第1版

出版时间:2025-09

内容提要:

本书是《从*构建大模型》一书的配套习题,旨在通过多种练习和自我评估方式,帮助读者巩固和深化对大语言模型构建过程的理解。书中内容围绕《从*构建大模型》一书的结构展开,覆盖代码和主要概念问题、批判性思维练习、单项选择题以及答案解析等内容。建议读者在阅读《从*构建大模型》一书之前、之后以及复习阶段使用本书,通过重复学习的方式巩固知识,并将其与已有的知识体系相融合。

作者简介:

塞巴斯蒂安·拉施卡(Sebastian Raschka) *影响力的人工智能*,GitHub项目LLMs-from-scratch的星标数达4万。现在大模型独角兽公司Lightning AI任*研究工程师。博士毕业于密歇根州立大学,2018~2023年威斯康星大学麦迪逊分校助理教授(终身教职),从事深度学习科研和教学。除本书外,他还写作了*书《大模型技术30讲》和《Python机器学习》。

目录:

第 1 章 理解大语言模型 1

主要概念速测 1

分节习题 3

11 什么是大语言模型 3

12 大语言模型的应用 4

13 构建和使用大语言模型的各个

阶段 5

14 Transformer 架构介绍 5

15 利用大型数据集 6

16 深入剖析GPT 架构 7

17 构建大语言模型 9

答案 11

第 2 章 处理文本数据 18

主要概念速测 18

分节习题 20

21 理解词嵌入 20

22 文本分词 20

23 将词元转换为词元ID 21

24 引入特殊上下文词元 22

25 BPE 23

26 使用滑动窗口进行数据采样 24

27 创建词元嵌入 26

28 编码单词位置信息 27

章节练习 28

答案 29

第3 章 编码注意力机制 38

主要概念速测 38

分节习题 40

31 长序列建模中的问题 40

32 使用注意力机制捕获数据依赖

关系 41

33 通过自注意力机制关注输入的

不同部分 41

34 实现带可训练权重的自注意力

机制 43

35 利用因果注意力隐藏未来词汇 44

36 将单头注意力扩展到多头注意力 45

章节练习 47

答案 48

第4 章 从头实现GPT 模型进行文本

生成 54

主要概念速测 54

分节习题 56

41 构建一个大语言模型架构 56

42 使用层归一化进行归一化* 58

43 实现具有GELU *函数的

前馈神经网络 59

44 添加快捷连接 60

45 连接Transformer 块中的注意力层

和线性层 61

46 实现GPT 模型 62

47 生成文本 63

章节练习 64

答案 65

第5 章 在无标签数据上进行预训练 74

主要概念速测 74

分节习题 76

51 评估文本生成模型 76

52 训练大语言模型 78

53 控制随机性的解码策略 79

54 使用PyTorch 加载和保存模型

权重 80

55 从OpenAI 加载预训练权重 81

章节练习 81

答案 83

第6 章 针对分类的微调 91

主要概念速测 91

分节习题 93

61 不同类型的微调 93

62 准备数据集 94

63 创建数据加载器 95

64 初始化带有预训练权重的模型 97

65 添加分类头 97

66 计算分类损失和*率 97

67 在有监督数据上微调模型 98

68 使用大语言模型作为垃圾消息

分类器 100

章节练习 101

答案 102

第7 章 通过微调遵循人类指令 110

主要概念速测 110

分节习题 112

71 指令微调介绍 112

72 为有监督指令微调准备数据集 112

73 将数据组织成训练批次 113

74 创建指令数据集的数据加载器 114

75 加载预训练的大语言模型 116

76 在指令数据上微调大语言模型 116

77 抽取并保存模型回复 117

78 评估微调后的大语言模型 117

章节练习 118

答案 119

附录A PyTorch 简介 129

问题 129

答案 132

附录B 参考文献和延伸阅读 136

附录C 练习的解决方案 137

附录D 为训练循环添加更多细节和

优化功能 138

问题 138

答案 139

附录E 使用LoRA 进行参数*微调 140

问题 140

答案 142

- 人民邮电出版社有限公司 (微信公众号认证)

- 人民邮电出版社微店,为您提供最全面,最专业的一站式购书服务

- 扫描二维码,访问我们的微信店铺

- 随时随地的购物、客服咨询、查询订单和物流...